适用于:

- MDP model 未知:经验的采样可以获取

- MDP model 已知:无法使用(e.g.原子级动力学),采样可以使用

策略、非策略学习:

- On-policy:动作采样来自policy π

- Off-policy:采样来自采样μ 或 来自于其他策略π,

On-policy MC control

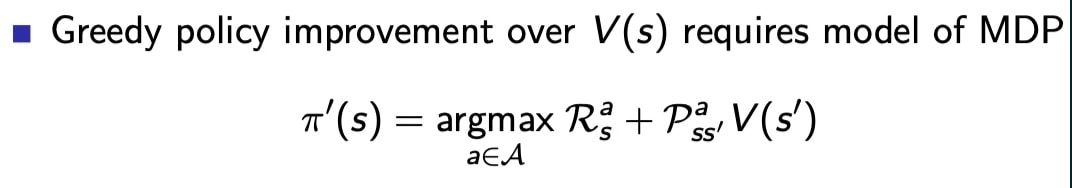

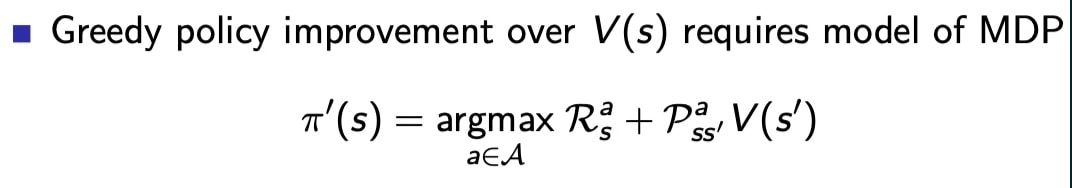

贪婪策略梯度法如果用V(s),需要MDP已知

对于已知MDP,可以通过策略迭代的方法,DP到最优策略

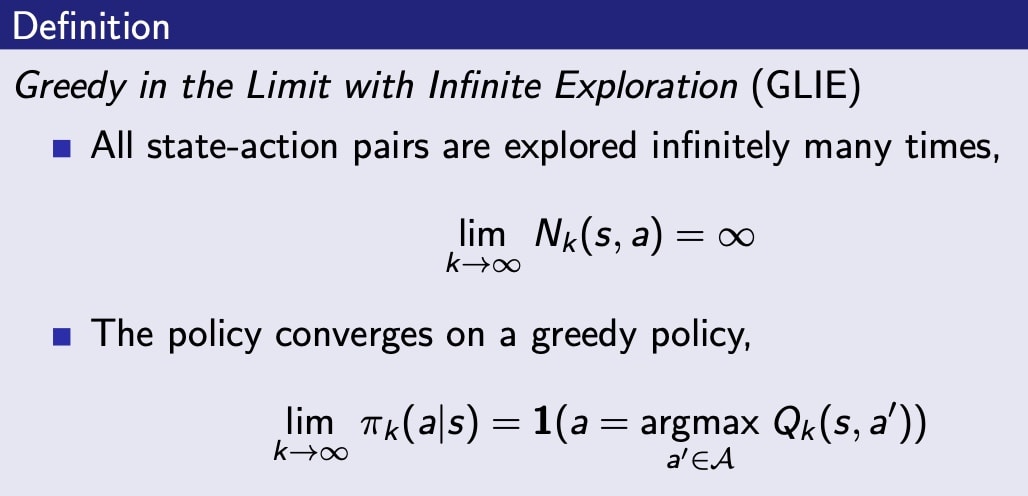

要实现不基于模型的控制,需要满足两个条件:

- 引入q(s,a)函数,而不是v(s)

- 探索,避免局部最优,引入ϵ,使π以小概率随机选择剩余动作,避免每次都选择已知较优动作

model-free policy using action-value function

用Q(s,a),不需要已知MDP

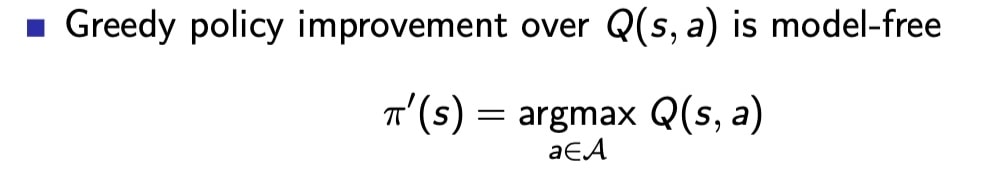

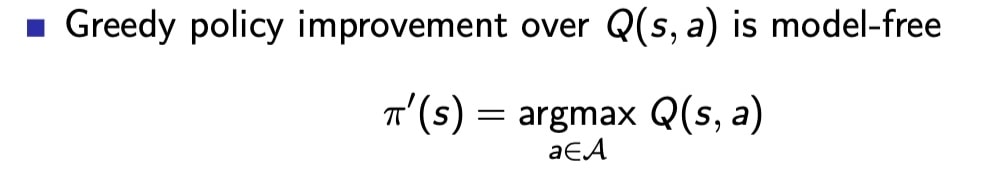

每个箭头对应一个段,Prediction一次,Control一次

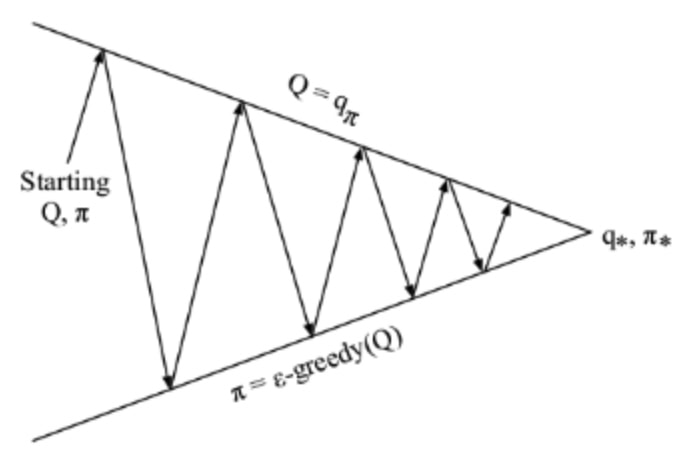

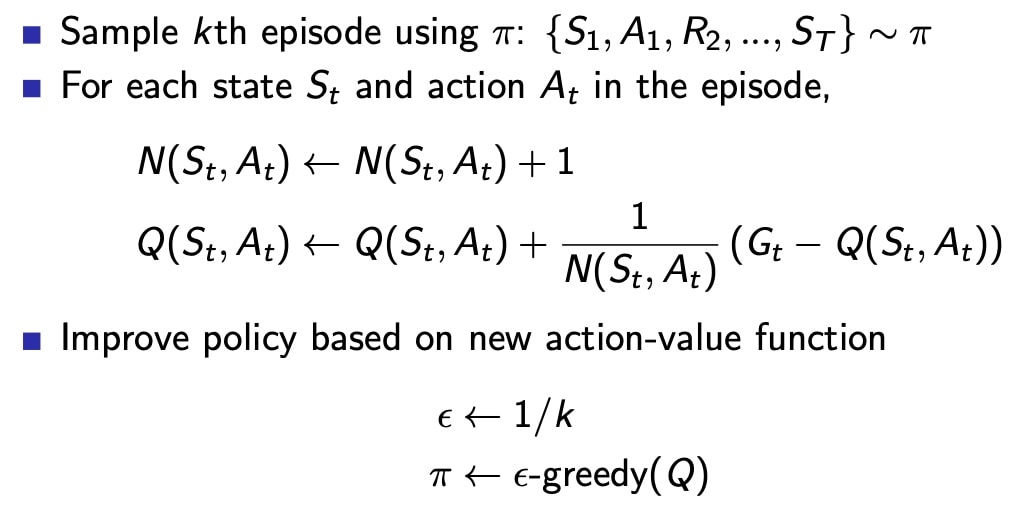

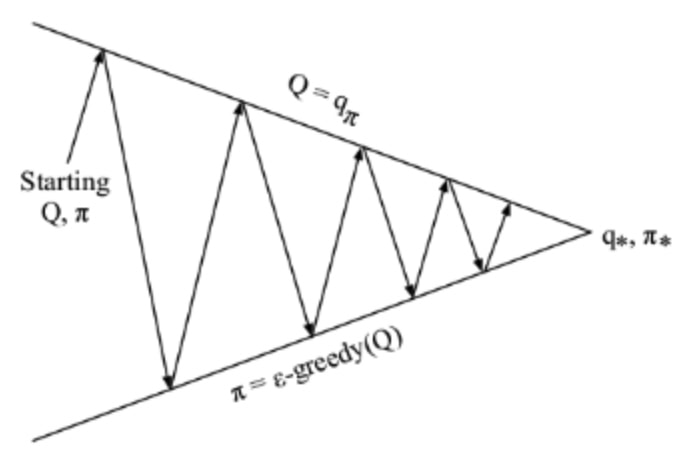

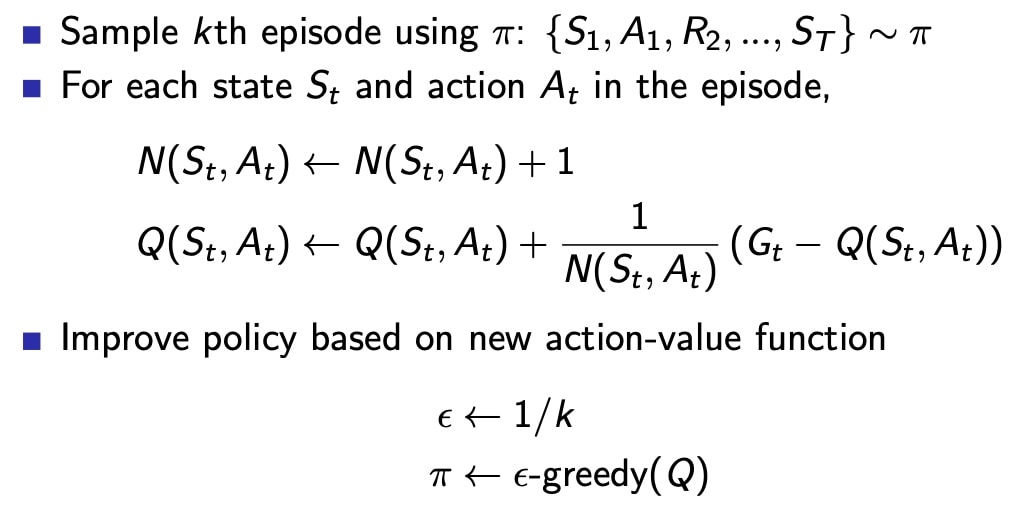

GLIE MC control(Greedy in the Limit with Infinite Exploration)

保证试验进行一定次数是,所有a-s状态都被访问到很多次

随实验次数进行,减小ϵ值

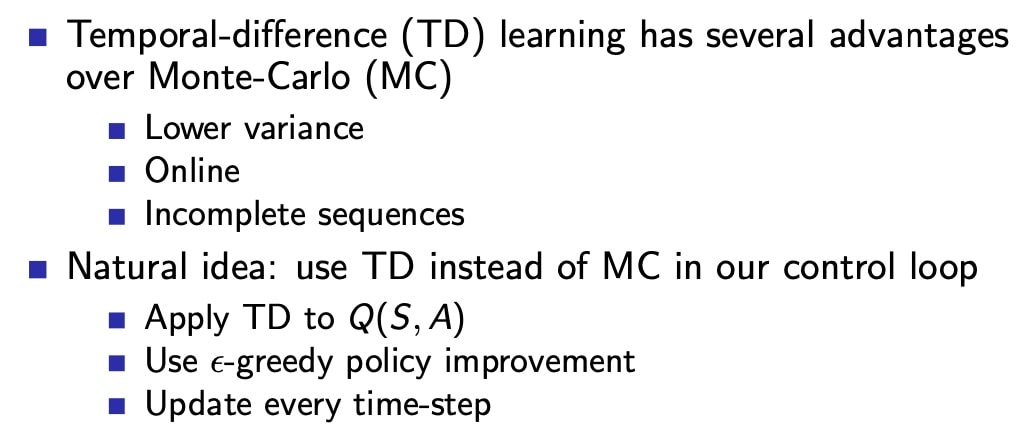

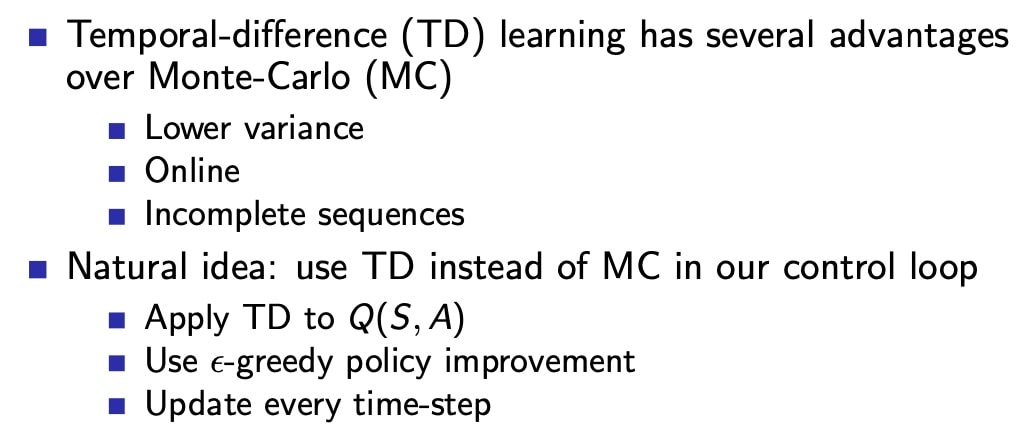

ON-policy TD learning

- TD与MC control 区别,希望引入TD的特性到on-policy learning

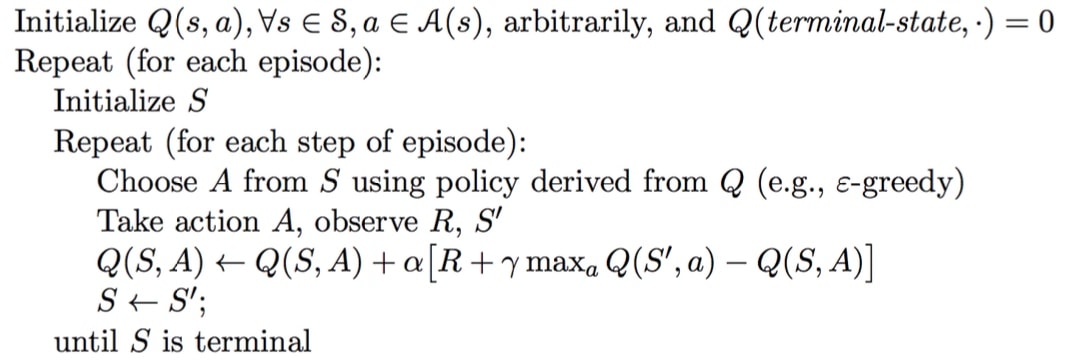

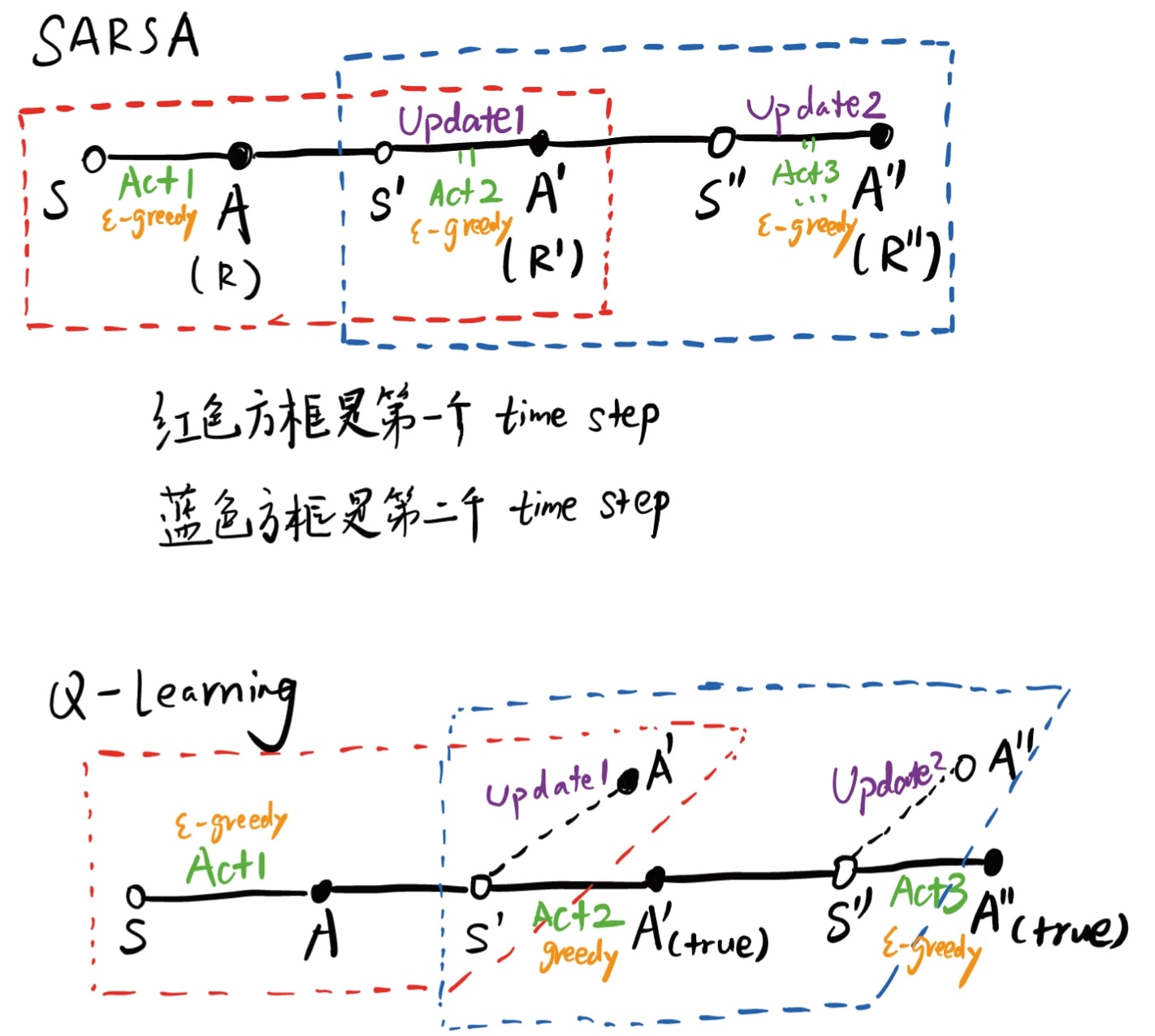

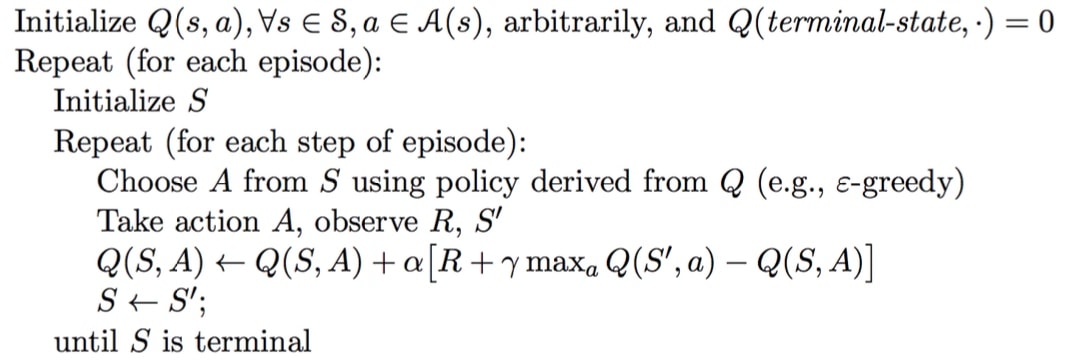

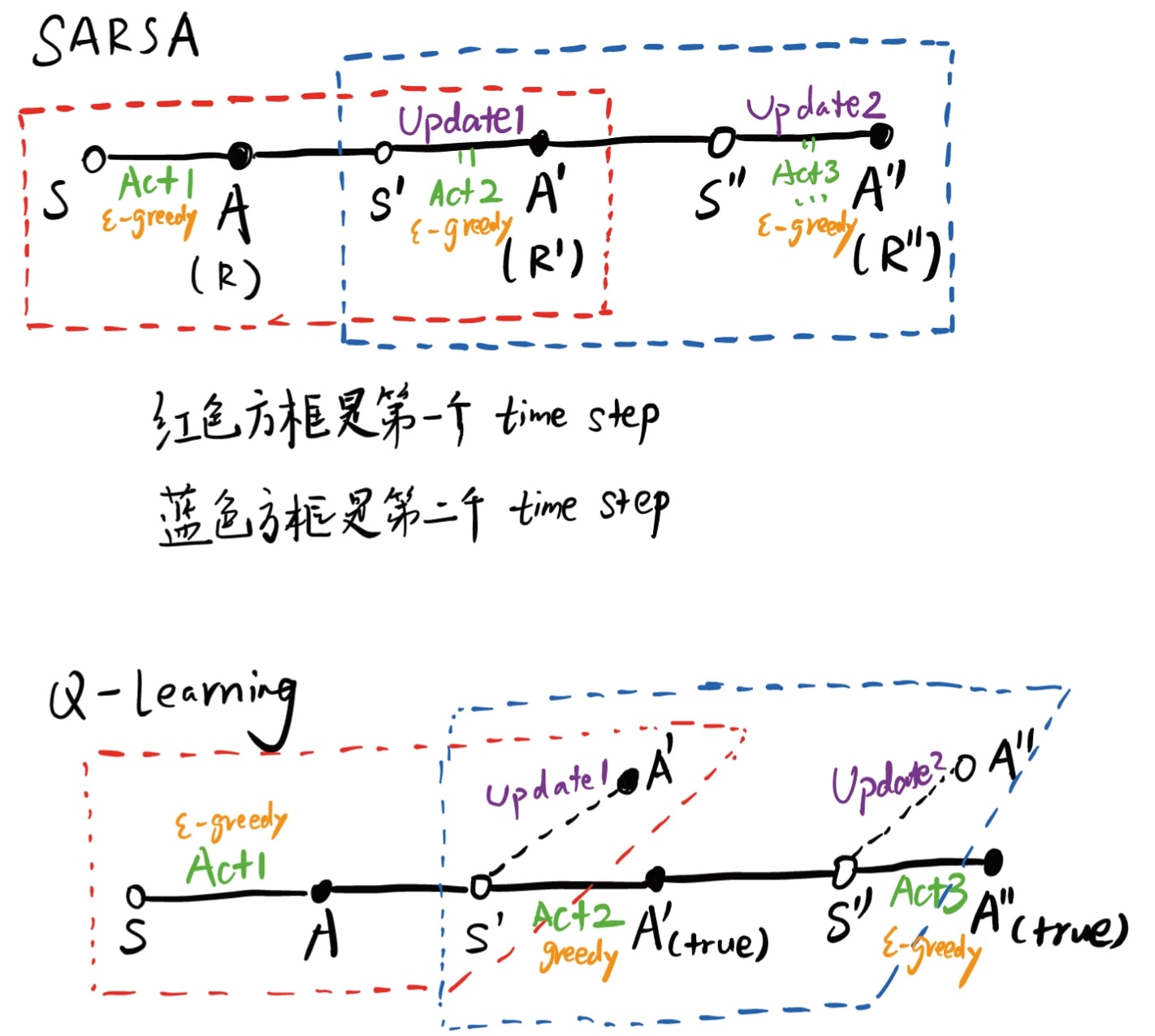

Sasra

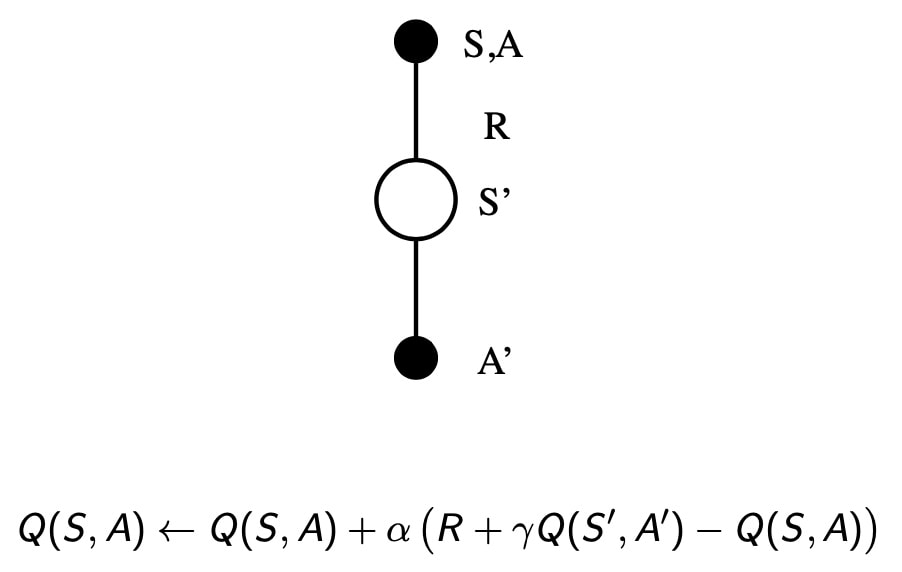

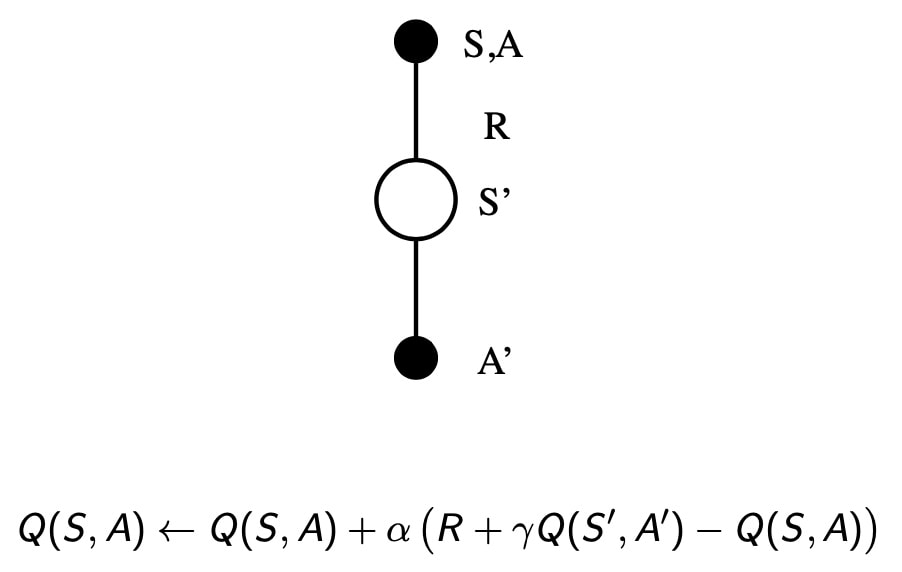

Sasra(one-step)

由贝尔曼公式推导

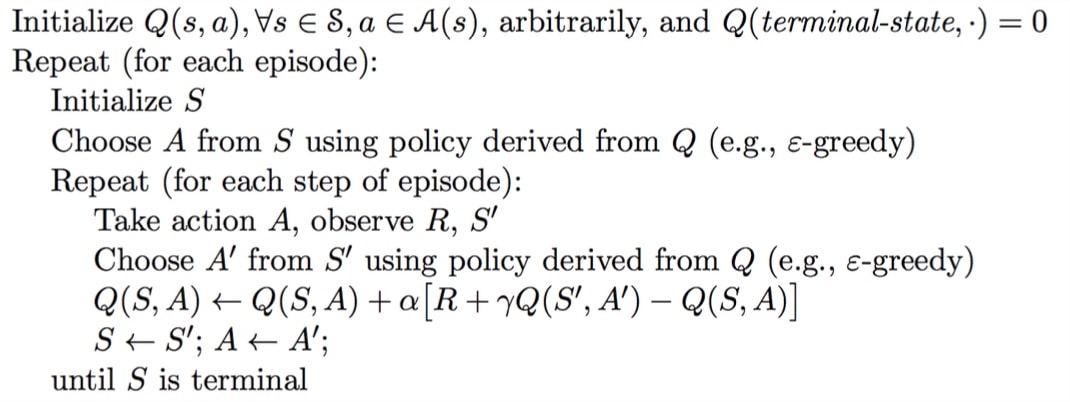

算法实现过程

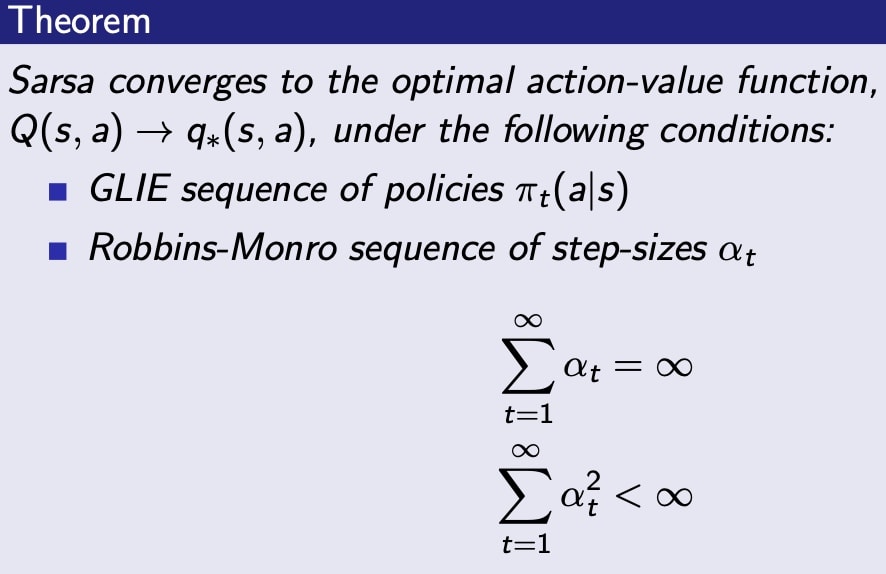

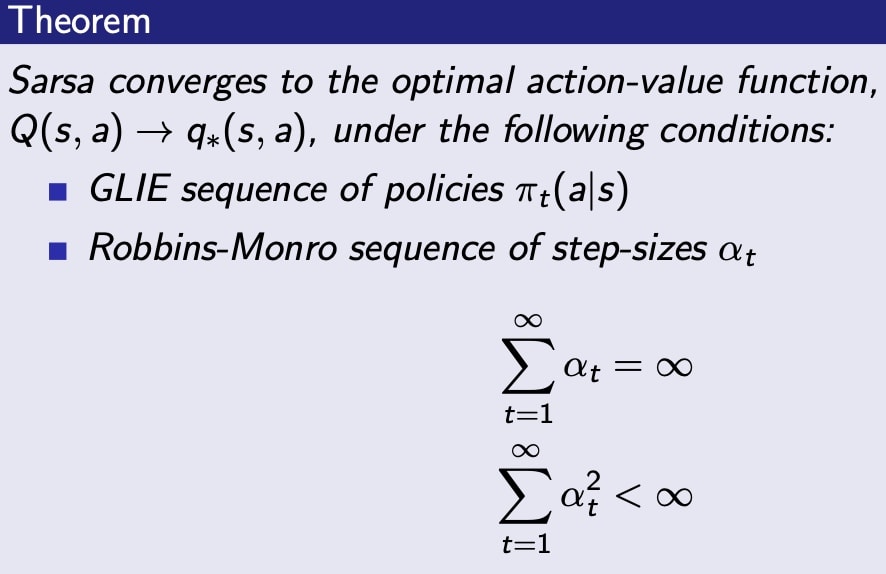

要保证Q值收敛,需要服从下列2个条件

- 策略符合GLIE特性

- 计算步长满足如图:

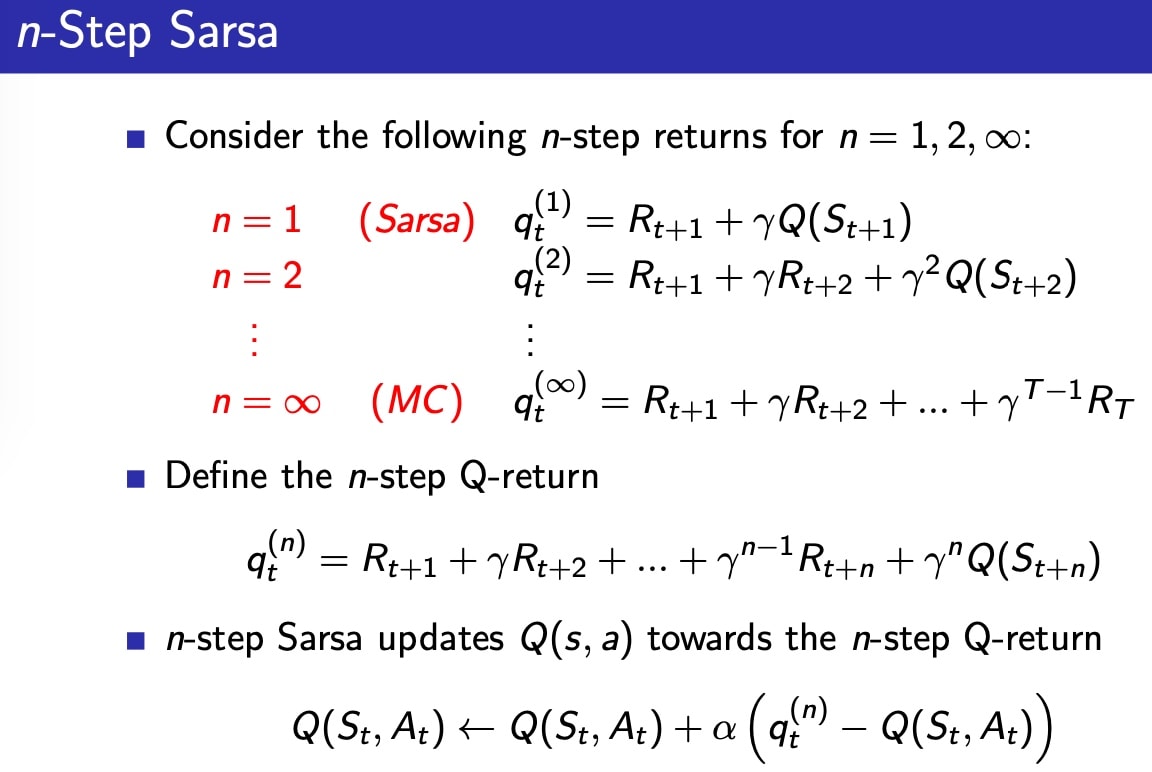

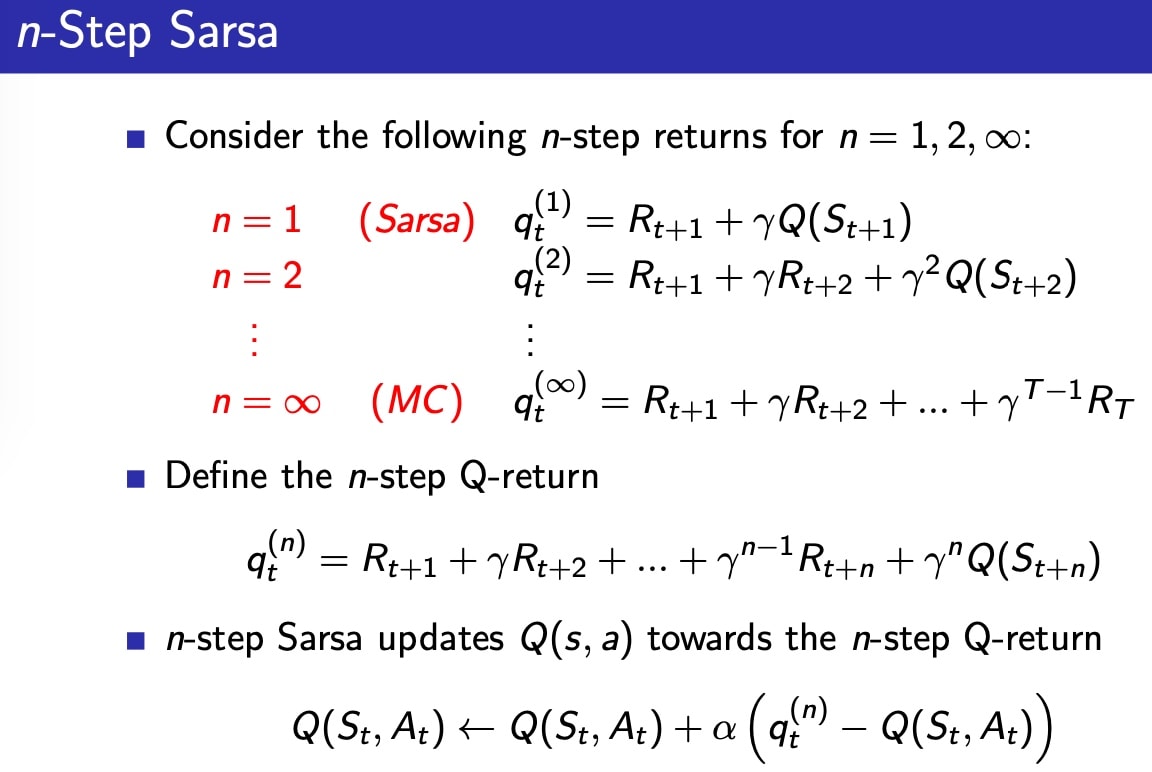

n-step Sarsa

与TD(λ)类似,扩展q的视野

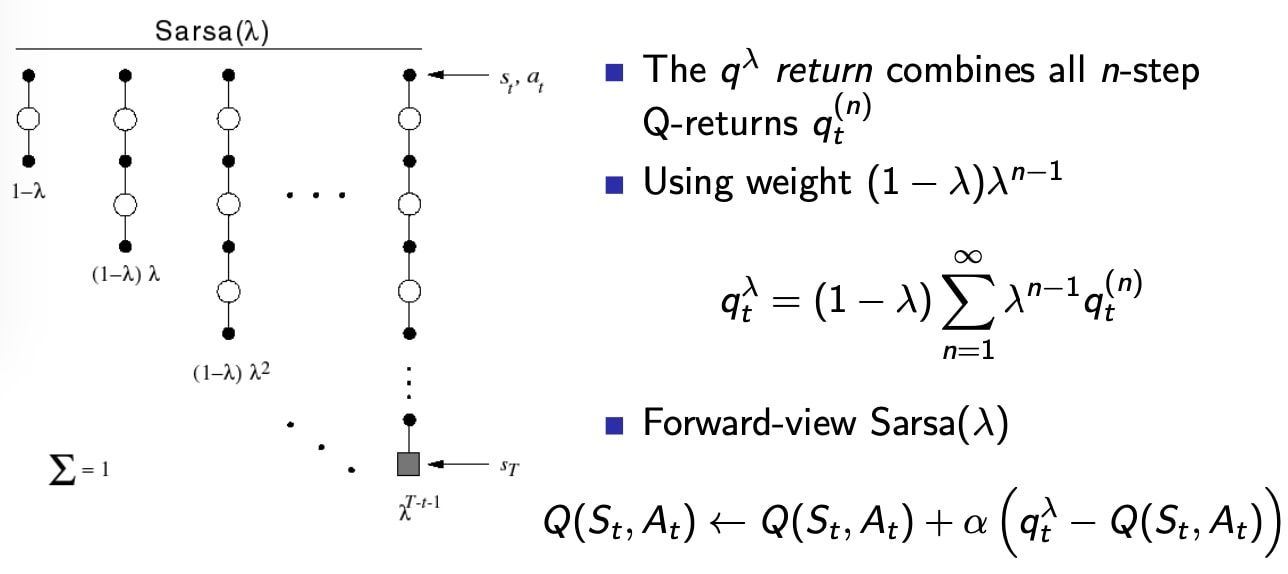

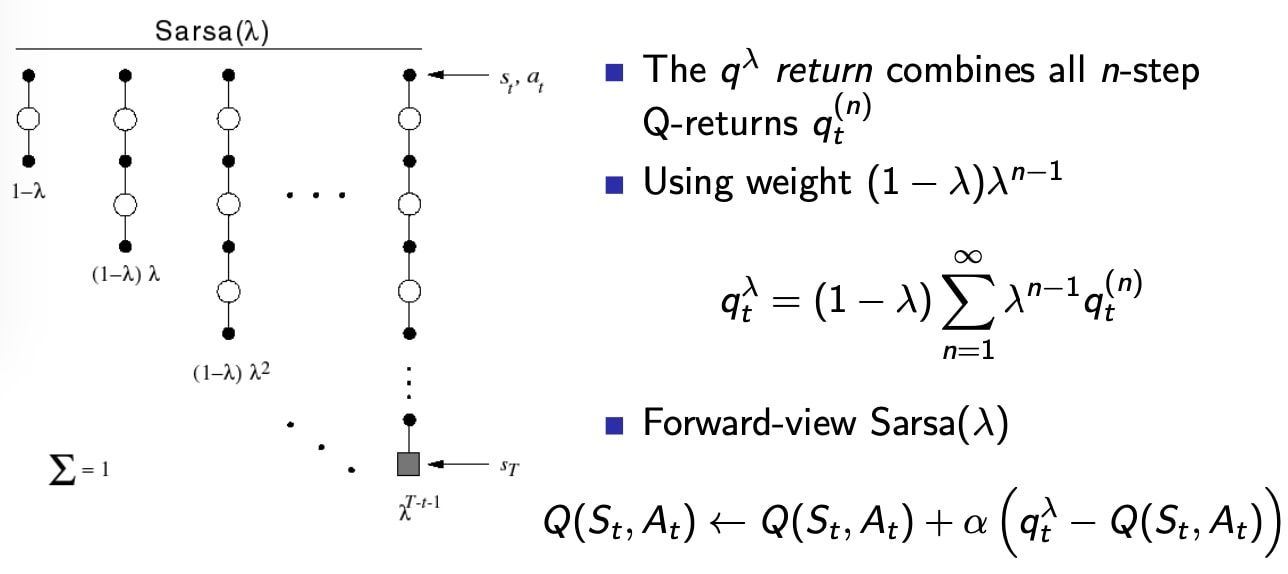

Forward view Sarsa(λ)

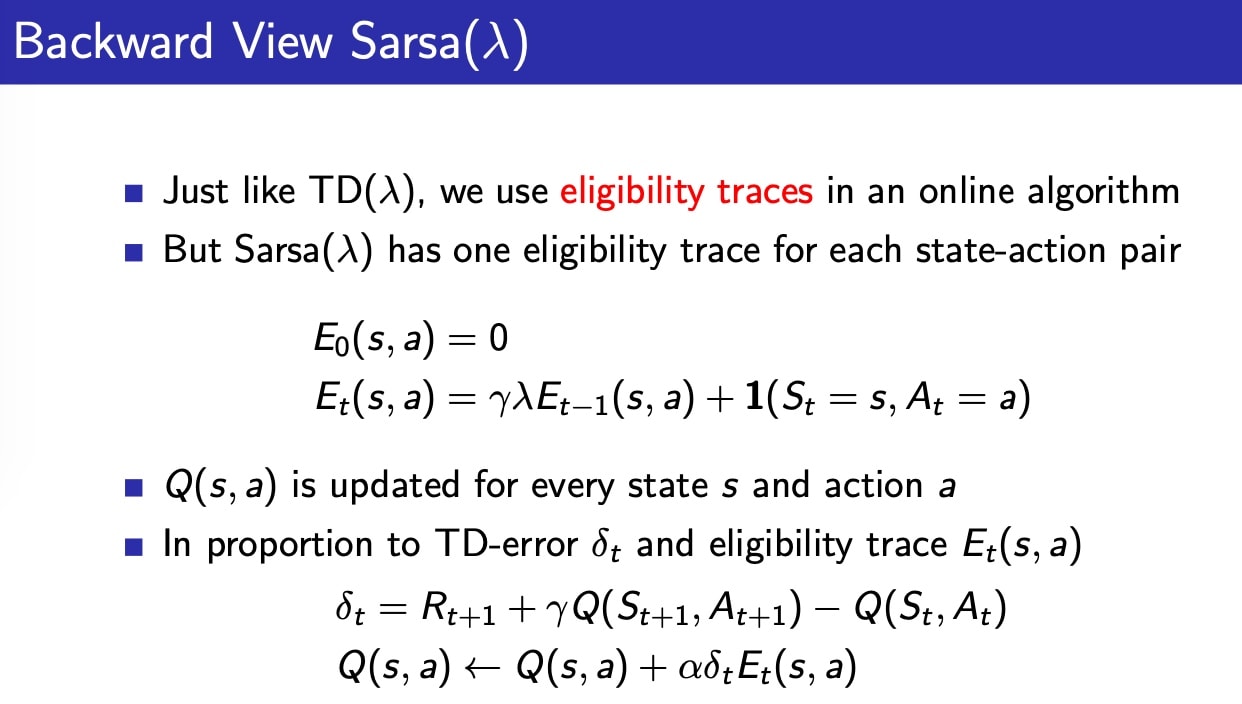

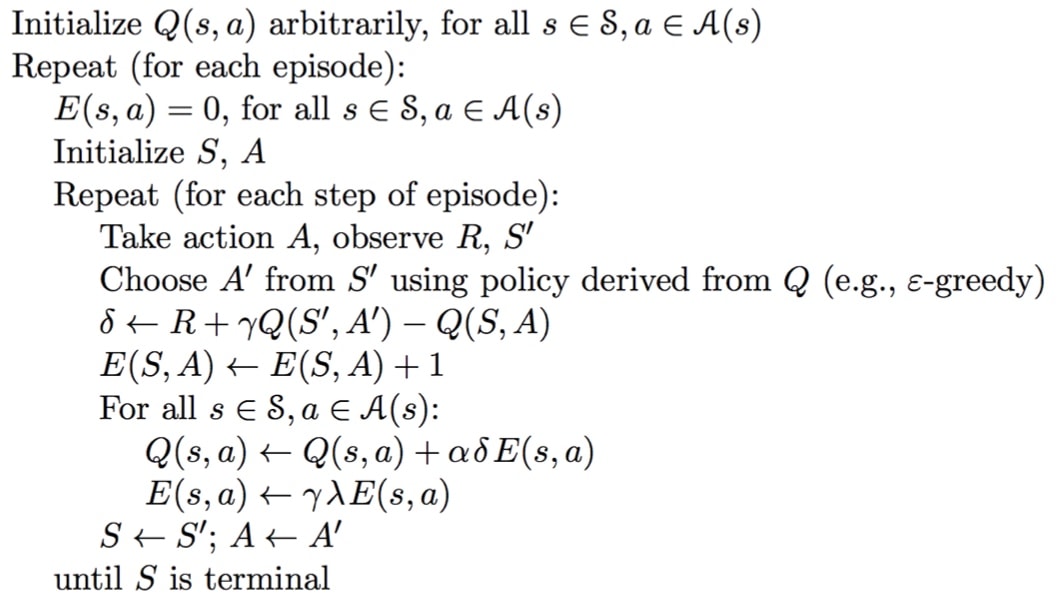

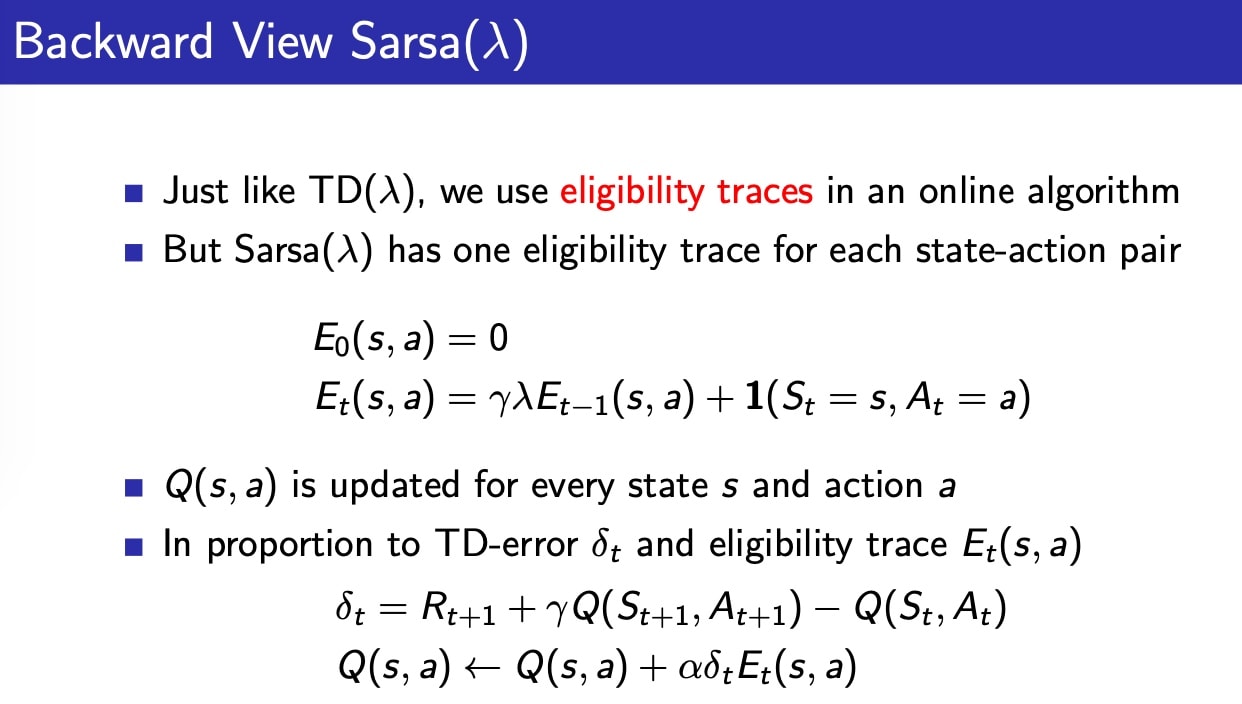

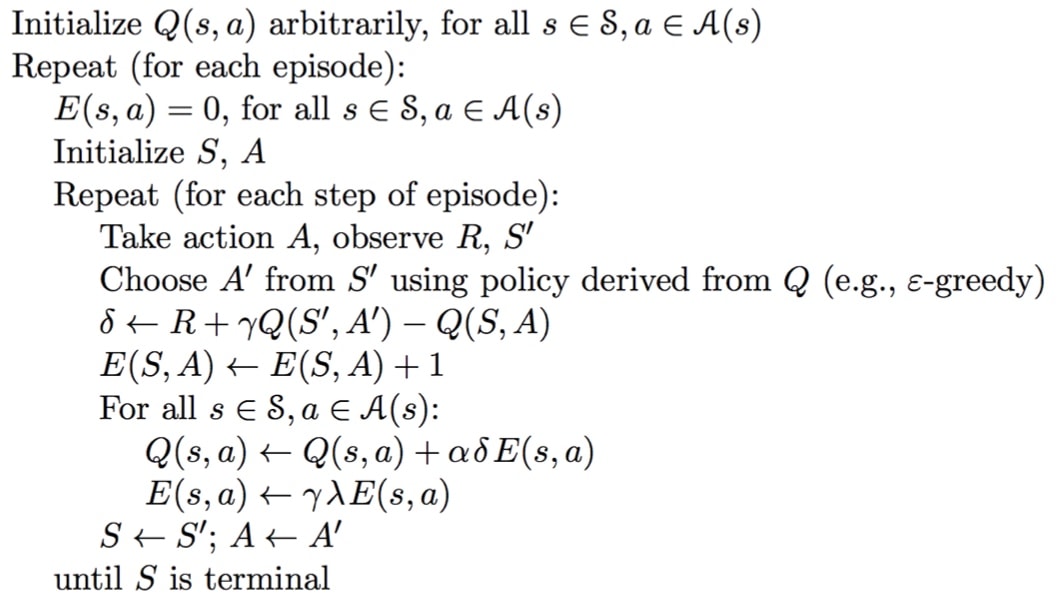

Backward view Sarsa(λ)

在正向视角中,迭代一次Q值,需要完整的一次episode

为了解决这个问题,引入迹的概念,实现incremental update

算法流程

Attention:迹E是属于episode的,切换episode后,E要归零

Off-policy learning

-

需求

- 从人类和其他agents的表现中学习

- 从old policies π1,π2...中学习

- 从随机策略中,学习到最优策略

- 从一个策略中,学习到多个策略

-

采样不同分布

EX∼P[f(X)]=∑P(X)f(X)=∑Q(X)Q(X)P(X)f(X)=EX∼Q[Q(X)P(X)f(X)]

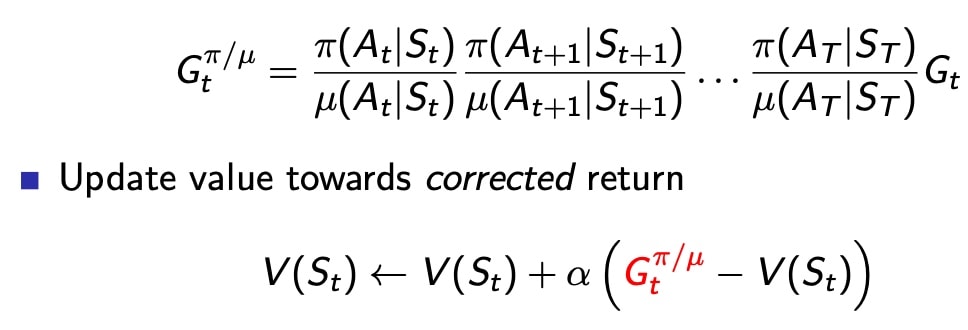

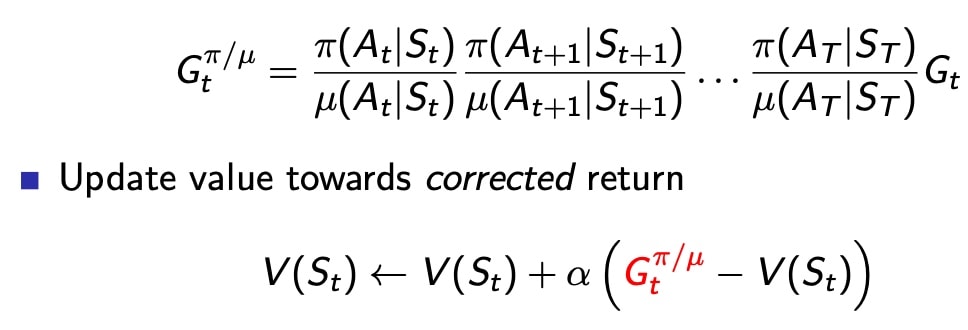

off-policy MC learning

引入了概率缩放系数,判断两个策略动作概率函数

- 缺点:

- 方差会增加

- μ=0无法计算

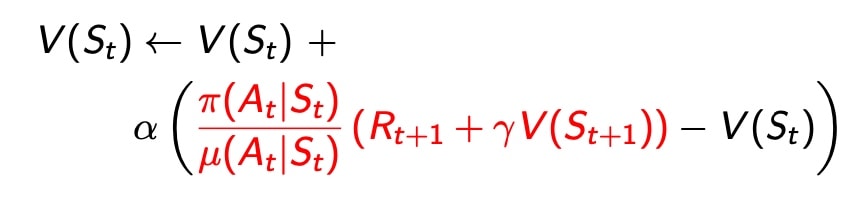

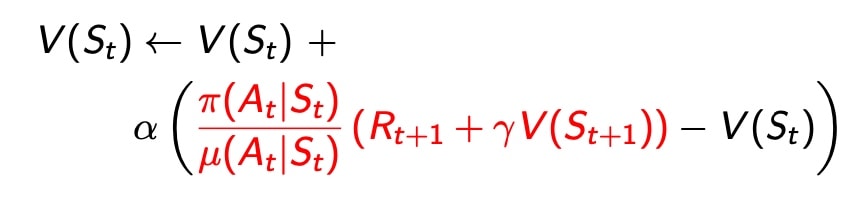

off-policy TD learning

利用期望分布的概念,在更新目标前x一个系数,对当前策略的置信度

Q-learning

特点

- 采用Q(s,a) instead of V(s)

- 不需要重要性采样 系数

- 下次动作用 At+1∼μ(⋅∣St)

- 动作服从策略 as A′∼π(⋅∣St)

更新方程如下

Q(St,At)←Q(St,At)+α(Rt+1+γQ(St+1,A′)−Q(St,At))

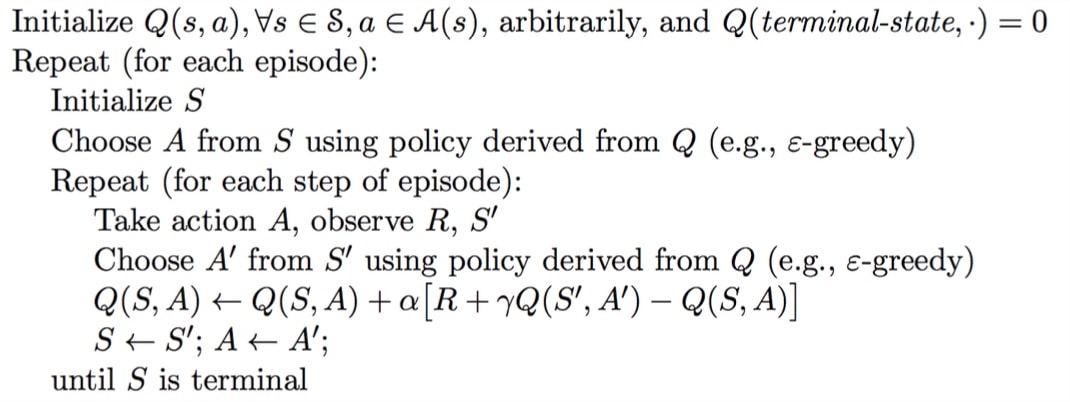

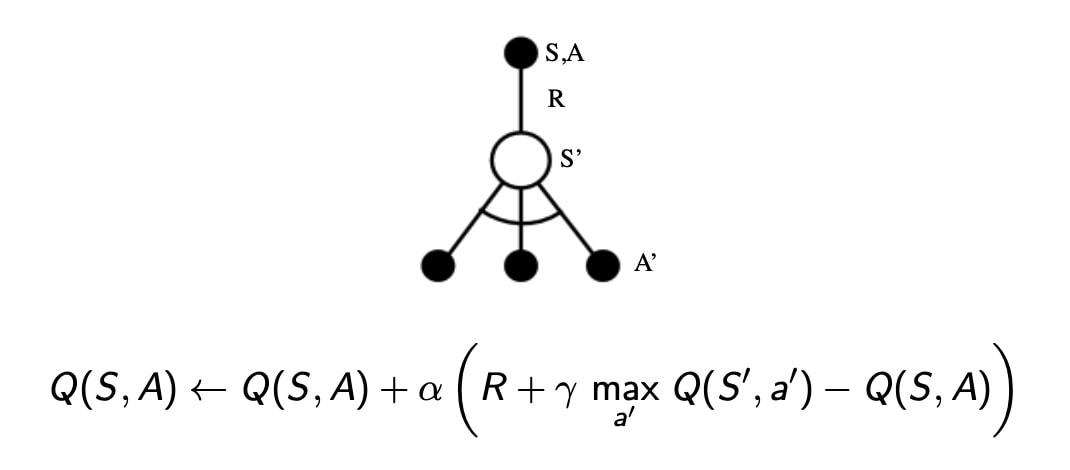

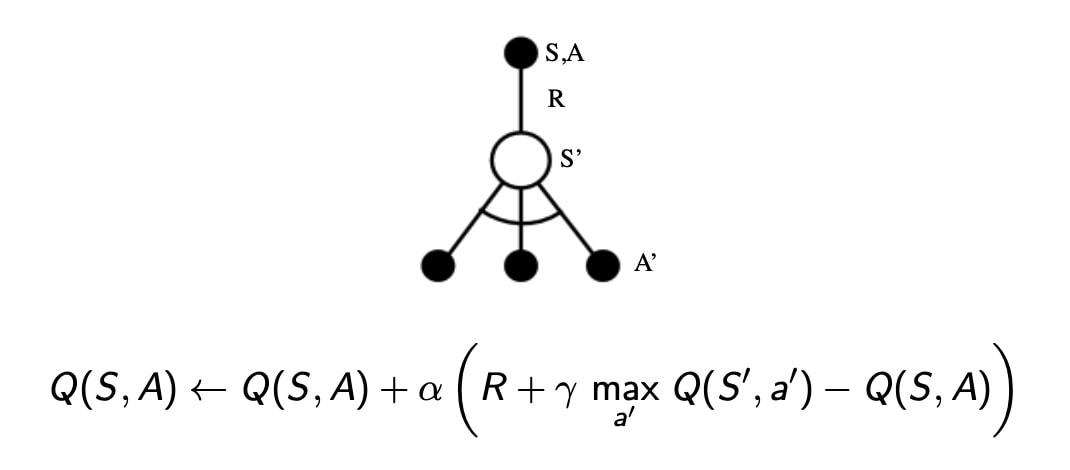

off-policy control with Q-learning

在学习过程中:

- Q值的Update Target 被优化,target policies是ϵ−greedy的

- Actor 执行的策略π被优化,执行ϵ−greedy

采用下式更新策略:

π(St+1)=a′argmaxQ(St+1,a′)

Q-learning target 简化为:

==Rt+1+γQ(St+1,A′)Rt+1+γQ(St+1,a′argmaxQ(St+1,a′))Rt+1+a′maxγQ(St+1,a′)

迭代使Q(s,a)→q∗(s,a)

Attention:在迭代过程中,动作采用ϵ−greedy策略,保证对位置环境的探索

算法流程

总结

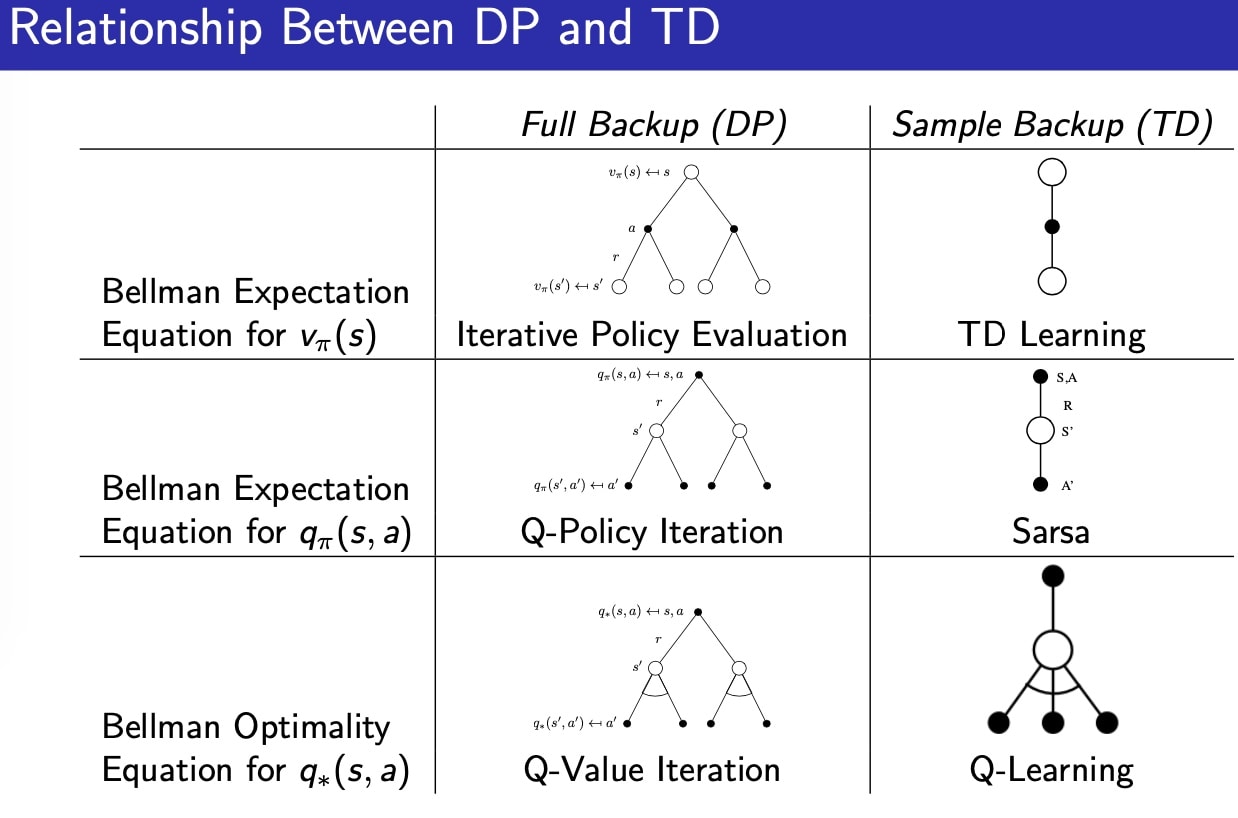

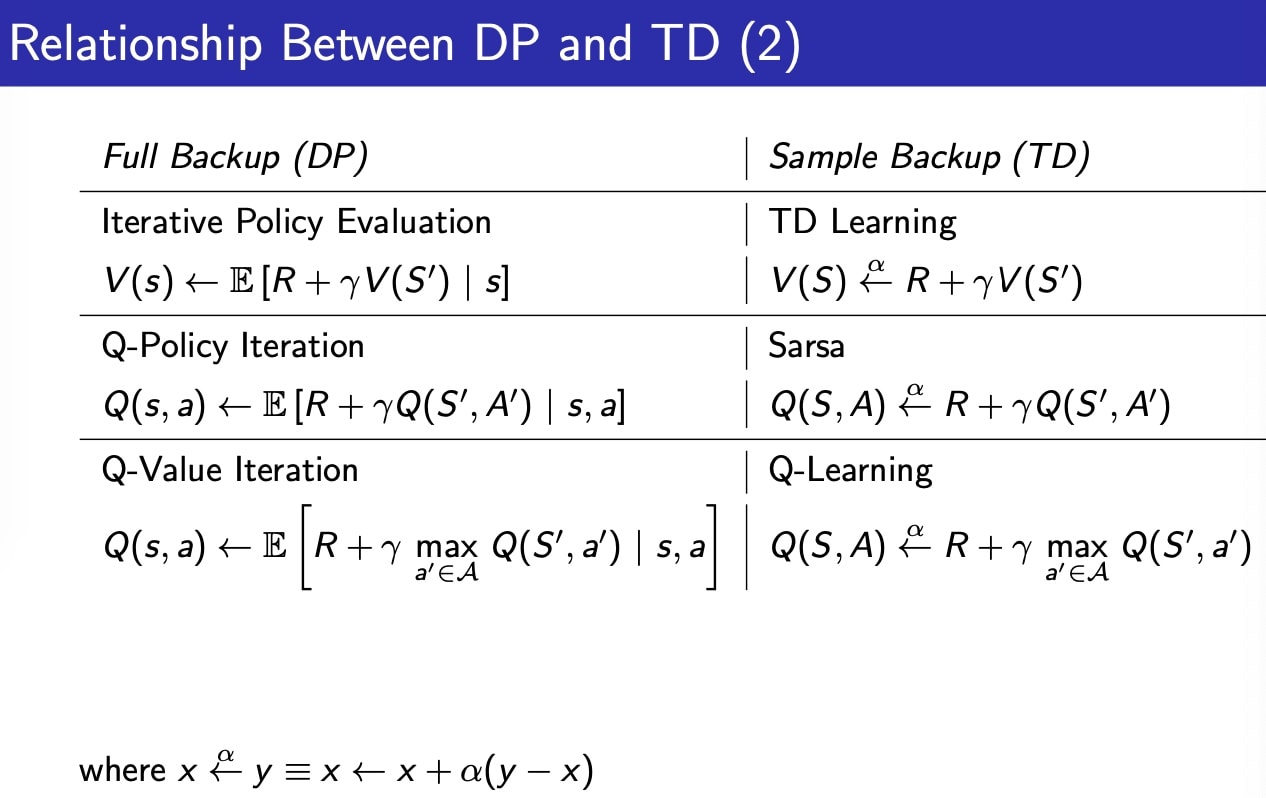

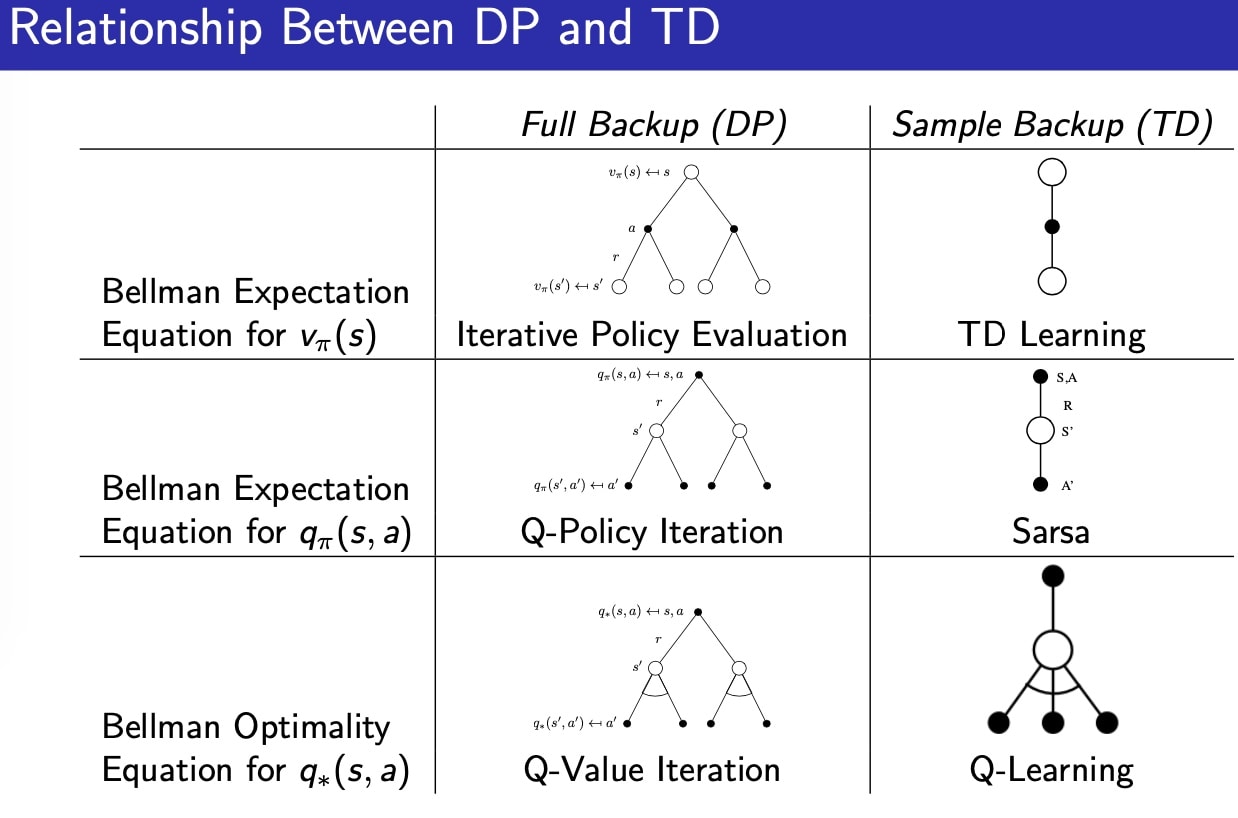

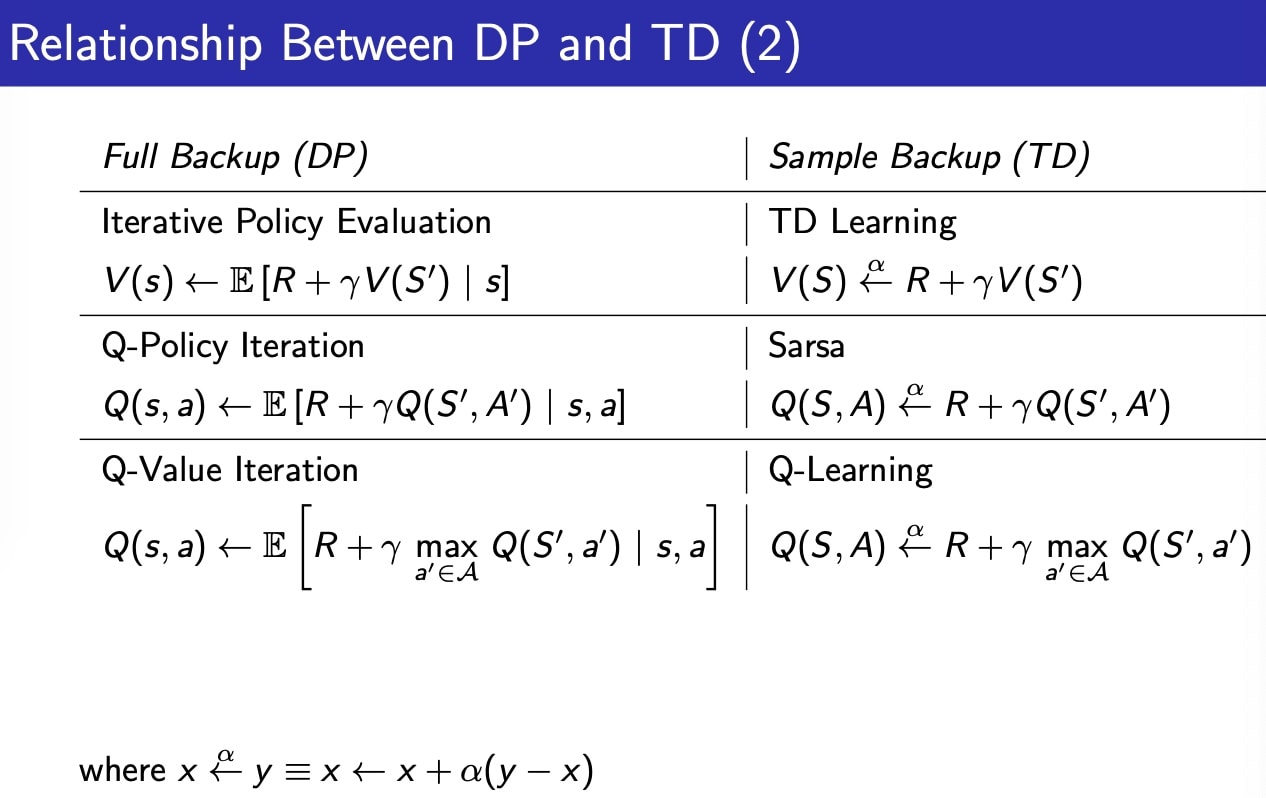

DP TD的关系

Q-learning 和 SARSA区别

区别在于:

-

Q-learning:

-

update: greedy策略,评估过程的A’没有实际执行

-

control:ϵ−greedy策略

-

SARSA:更新和执行都用ϵ−greedy策略